Word Embeddings und Vektordatenbanken haben in den letzten Jahren die Art und Weise revolutioniert, wie Daten verarbeitet, gespeichert und analysiert werden. Diese Technologien sind besonders im Bereich der künstlichen Intelligenz und des maschinellen Lernens von großer Bedeutung. Um die Grundlagen, Anwendungen und potenziellen Zukunftsperspektiven besser zu verstehen, werfen wir einen detaillierten Blick auf Word Embeddings und Vektordatenbanken.

Einführung in Word Embeddings und Vektordatenbanken

Word Embeddings und Vektordatenbanken sind zwei eng miteinander verbundene Technologien, die es ermöglichen, komplexe Daten wie Texte, Bilder oder Videos in einer für Maschinen verständlichen Form zu speichern und zu analysieren. Während Word Embeddings sich speziell auf die Darstellung von Wörtern in numerischen Vektoren konzentrieren, bieten Vektordatenbanken eine Plattform, um diese Vektoren effizient zu speichern und abzufragen. Gemeinsam eröffnen sie eine Vielzahl von Anwendungen, von der Sprachverarbeitung bis hin zur KI-gestützten Suche.

Was sind Word Embeddings?

Definition und Funktionsweise

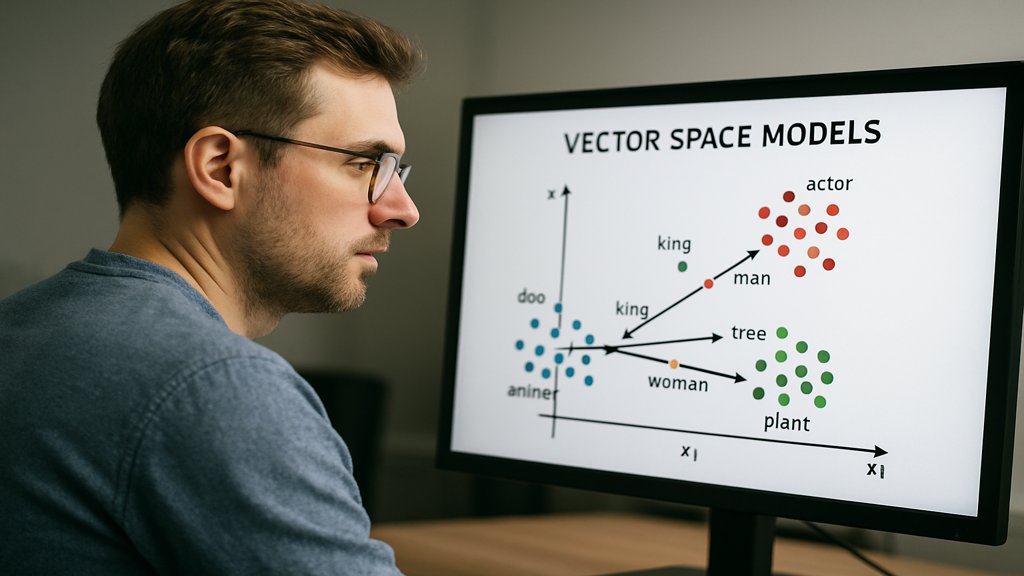

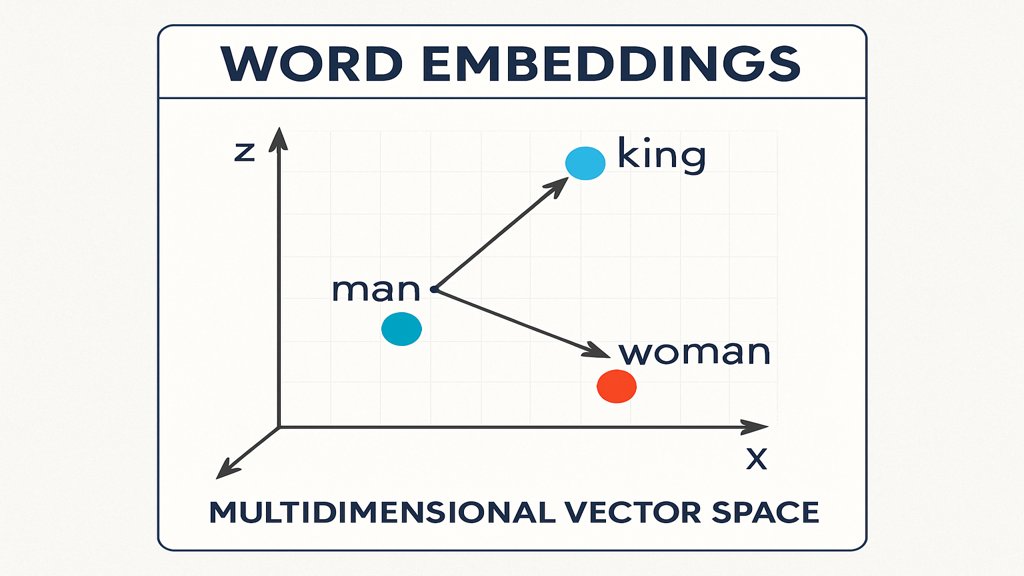

Word Embeddings sind numerische Darstellungen von Wörtern in einem mehrdimensionalen Raum. Jedes Wort wird als ein Vektor dargestellt, wobei die Position des Vektors die semantische Bedeutung des Wortes widerspiegelt. Einfacher gesagt: Wörter mit ähnlicher Bedeutung liegen im Vektorraum näher beieinander. Diese Technik hilft Computern, die Bedeutung von Sprache besser zu verstehen, da sie die kontextuelle Beziehung zwischen Wörtern modelliert.

Die Funktionsweise basiert auf dem Prinzip, dass Wörter häufig in ähnlichen Kontexten auftauchen. Modelle wie Word2Vec oder GloVe analysieren große Textmengen und lernen aus der Häufigkeit und den Mustern, in denen Wörter gemeinsam erscheinen. So wird aus einem abstrakten Begriff wie „Apfel“ ein numerischer Vektor, den ein Computer interpretieren kann.

Wie Word Embeddings erstellt werden

Die Erstellung von Word Embeddings erfolgt durch maschinelle Lernalgorithmen, die große Textkorpora analysieren. Zwei der häufigsten Methoden sind:

-

Word2Vec: Dieses Modell verwendet neuronale Netzwerke, um Vektoren basierend auf der Nachbarschaft der Wörter zu generieren. Es gibt zwei Hauptansätze: Continuous Bag of Words (CBOW) und Skip-Gram.

-

GloVe: Anstatt auf Nachbarschaftsbeziehungen zu fokussieren, analysiert GloVe globale Wortko-Okkurrenzen innerhalb eines Textkorpus, um Vektoren zu erstellen.

Beide Ansätze benötigen große Datenmengen, um präzise Ergebnisse zu liefern. Die Ausgabe sind Vektoren, die mathematische Beziehungen zwischen Wörtern darstellen.

Beispiele für Word Embedding-Modelle

Es gibt verschiedene Modelle, die Word Embeddings generieren. Zu den bekanntesten gehören:

- Word2Vec: Entwickelt von Google, ist es eines der ersten und bekanntesten Modelle.

- GloVe: Dieses Modell wurde von der Stanford University entwickelt und ist besonders für globale Textanalysen geeignet.

- FastText: Ein Modell von Facebook, das auch Subwörter berücksichtigt und so flexibler in Bezug auf unbekannte Wörter ist.

- BERT: Ein modernes Modell von Google, das kontextabhängige Embeddings erzeugt und besonders für NLP-Aufgaben geeignet ist.

Diese Modelle haben ihre Stärken und Schwächen und werden je nach Anwendungsfall eingesetzt.

Anwendungen von Word Embeddings

Natural Language Processing (NLP)

Word Embeddings sind ein essenzieller Bestandteil von NLP. Aufgaben wie maschinelle Übersetzung, Textklassifikation und Sentiment-Analyse profitieren stark von der Fähigkeit, die semantische Bedeutung von Wörtern zu erfassen. Beispielsweise kann ein Modell durch Word Embeddings erkennen, dass „glücklich“ und „zufrieden“ ähnliche Bedeutungen haben, während „traurig“ eine gegensätzliche Bedeutung hat. Weitere Einblicke in die vielseitigen Anwendungen bietet der Bereich Natural Language Processing (NLP).

Empfehlungssysteme

In Empfehlungssystemen helfen Word Embeddings dabei, Benutzerpräferenzen zu analysieren und passende Inhalte vorzuschlagen. Beispielsweise können sie verwendet werden, um ähnliche Produkte oder Dienstleistungen zu identifizieren, basierend auf den Beschreibungen oder Bewertungen, die Nutzer hinterlassen.

Bild- und Videodatenanalyse

Obwohl Word Embeddings ursprünglich für Texte entwickelt wurden, finden sie auch Anwendung in der Analyse von Bild- und Videodaten. Hier werden ähnliche Konzepte genutzt, um visuelle Inhalte mit semantischer Bedeutung zu versehen, was z. B. bei der automatischen Bildbeschriftung oder der Suche nach ähnlichen Bildern hilfreich ist.

Was sind Vektordatenbanken?

Definition und Nutzen

Vektordatenbanken sind spezialisierte Datenbanksysteme, die darauf ausgelegt sind, hochdimensionale Vektoren zu speichern und zu verwalten. Im Kontext von Word Embeddings speichern sie die numerischen Darstellungen von Wörtern und ermöglichen effiziente Abfragen und Analysen. Ihr Hauptnutzen liegt in der Fähigkeit, Ähnlichkeiten zwischen Vektoren schnell und präzise zu berechnen, was für Anwendungen wie die semantische Suche entscheidend ist.

Funktionsweise von Vektordatenbanken

Die Funktionsweise beruht auf speziellen Algorithmen, die hochdimensionale Räume effizient durchsuchen können. Häufig genutzte Methoden sind:

- Annäherungsbasierte Suche: Statt eine exakte Übereinstimmung zu suchen, wird ein „annähernder“ nächster Nachbar im Vektorraum gefunden, was die Suche deutlich beschleunigt.

- Indexierung: Vektordatenbanken nutzen Techniken wie k-d-Bäume oder Hashing, um Vektoren effizient zu organisieren und zu durchsuchen.

Diese Mechanismen ermöglichen es, Millionen von Vektoren in Echtzeit zu durchsuchen, was für Anwendungen mit großen Datensätzen entscheidend ist.

Vergleich von Vektordatenbanken

Es gibt verschiedene Vektordatenbanken, die sich in ihrer Leistung, Skalierbarkeit und Benutzerfreundlichkeit unterscheiden. Einige der bekanntesten sind:

- Milvus: Eine Open-Source-Lösung, die sich durch Skalierbarkeit und einfache Integration auszeichnet.

- Pinecone: Ein cloudbasierter Dienst, der sich auf Geschwindigkeit und Benutzerfreundlichkeit konzentriert.

- Weaviate: Eine KI-gestützte Vektordatenbank mit erweiterten Funktionen wie semantischer Suche.

Die Wahl der richtigen Vektordatenbank hängt stark vom jeweiligen Anwendungsfall ab.

Anwendungsfälle für Vektordatenbanken

Effiziente Ähnlichkeitssuche

Eine der Hauptanwendungen ist die Ähnlichkeitssuche. Vektordatenbanken ermöglichen es, ähnliche Inhalte wie Texte, Bilder oder Videos in großen Datensätzen schnell zu finden. Dies ist besonders in der semantischen Suche oder bei Empfehlungssystemen von Nutzen.

Einsatz in KI und maschinellem Lernen

Vektordatenbanken spielen eine Schlüsselrolle in KI- und ML-Anwendungen, indem sie den Zugriff auf hochdimensionale Daten erleichtern. Modelle können direkt auf die Vektoren zugreifen, um Muster zu erkennen oder Vorhersagen zu treffen.

Verwaltung von hochdimensionalen Daten

Die Verwaltung von hochdimensionalen Daten ist eine Herausforderung, die Vektordatenbanken effizient lösen können. Sie speichern und organisieren diese Daten so, dass sie für Abfragen und Analysen leicht zugänglich sind. Dies ist besonders wichtig in Bereichen wie der medizinischen Forschung oder der Bildverarbeitung.

Fazit: Die Zukunft von Word Embeddings und Vektordatenbanken

Word Embeddings und Vektordatenbanken haben bereits bewiesen, dass sie die Datenanalyse und -speicherung nachhaltig verbessern können. In der Zukunft werden diese Technologien wahrscheinlich noch intensiver genutzt, insbesondere in Bereichen wie personalisierter KI, semantischer Suche und der Analyse komplexer Datensätze. Mit der Weiterentwicklung von Modellen und Datenbanken eröffnen sich neue Möglichkeiten, die sowohl die Effizienz als auch die Präzision in der Datenverarbeitung steigern werden. Sie sind zweifellos Technologien, die die digitale Welt maßgeblich prägen werden.

FAQ zum Thema Word embeddings und vektordatenbanken

Was sind Word Embeddings?

Word Embeddings sind numerische Darstellungen von Wörtern in einem mehrdimensionalen Vektorraum, die deren Bedeutungsähnlichkeit abbilden.

Wofür werden Vektordatenbanken verwendet?

Vektordatenbanken speichern und verwalten hochdimensionale Vektordaten, die z. B. aus Word Embeddings oder Bildmerkmalen stammen, und ermöglichen effiziente Ähnlichkeitssuchen.

Welche Vorteile bieten Word Embeddings in der NLP?

Word Embeddings ermöglichen es, semantische Beziehungen zwischen Wörtern zu modellieren, was die Leistung von NLP-Anwendungen wie Textklassifikation und maschinellem Übersetzen verbessert.